Por Que o SlowFast-LLaVA-1.5 Pode Ser a Inovação Para Entendimento de Vídeos Longos—Sem o Alto Custo Computacional

O Verdadeiro Gargalo no Processamento de Vídeos por IA? Tokens, Não Apenas Poder de Processamento

O conteúdo de vídeo de longa duração está explodindo. De filmagens de vigilância a palestras educacionais, a necessidade de extrair insights de vídeos de vários minutos — ou até mesmo horas — nunca foi tão grande. Mas para a IA, entender o contexto temporal de longo alcance em vídeo não é apenas uma questão de adicionar mais frames ou ajustar um modelo maior.

O verdadeiro desafio? Eficiência de tokens.

A maioria dos Modelos de Linguagem Grandes de Vídeo (Video LLMs) existentes têm dificuldades para escalar. Eles processam grandes quantidades de dados, mas consomem muito poder de processamento e memória, tornando-os impraticáveis para dispositivos móveis, edge ou até mesmo muitas implementações empresariais.

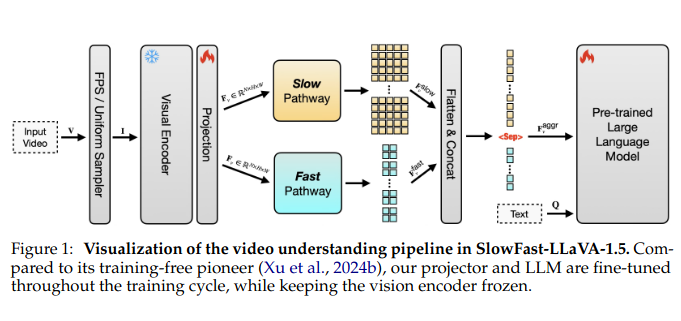

É aí que o SlowFast-LLaVA-1.5 entra em cena. Desenvolvido como uma solução reproduzível e com uso eficiente de tokens para o entendimento de vídeos longos, ele combina uma nova abordagem de processamento de dois fluxos com um pipeline de treinamento enxuto — oferecendo desempenho de ponta, mesmo com modelos menores (tão baixos quanto 1 bilhão de parâmetros).

Para empresas que apostam em IA escalável e para investidores que buscam soluções de IA implementáveis na borda (edge), este modelo representa uma mudança técnica e estratégica significativa.

A Arquitetura de Dois Fluxos Que Mudou o Jogo

No núcleo do SlowFast-LLaVA-1.5 está uma reviravolta arquitetônica inteligente emprestada e adaptada de trabalhos anteriores em reconhecimento de vídeo: um mecanismo SlowFast. Veja como funciona:

- O fluxo Slow processa menos frames em uma resolução mais alta, capturando detalhes espaciais ricos de quadros-chave selecionados.

- O fluxo Fast lida com muito mais frames, mas com menos granularidade, concentrando-se no movimento e no fluxo temporal.

Ao combinar esses caminhos e agregar suas saídas, o modelo captura tanto o que está acontecendo em cada frame quanto como as cenas evoluem ao longo do tempo — sem se afogar em tokens.

Esta é uma mudança em relação aos transformadores de vídeo monolíticos que lutam para equilibrar a precisão espacial e o alcance temporal. O resultado? O SlowFast-LLaVA-1.5 processa quase o dobro de frames usando apenas 65% dos tokens em comparação com outros modelos líderes.

Treinamento Mais Enxuto, Adoção Mais Ampla

Treinar grandes modelos de vídeo é notoriamente complicado — muitas vezes envolvendo conjuntos de dados proprietários, pipelines de vários estágios e ajuste intensivo de recursos. Os autores do SlowFast-LLaVA-1.5 adotaram uma rota mais pragmática:

- Estágio I – Ajuste Fino Apenas com Imagens: O modelo é treinado primeiro em conjuntos de dados de imagens disponíveis publicamente para estabelecer o embasamento visual e o raciocínio geral.

- Estágio II – Treinamento Conjunto de Vídeo e Imagem: Em seguida, ele é exposto a um conjunto selecionado de dados de vídeo e imagem, permitindo que o modelo aprenda a dinâmica espacial e temporal.

Os conjuntos de dados são de código aberto e a abordagem é reproduzível — dois atributos frequentemente ausentes nos lançamentos recentes de LLM. Essa ênfase na acessibilidade não é apenas acadêmica; ela diminui a barreira de entrada para empresas menores ou startups que desejam integrar IA de vídeo avançada.

Benchmarks Que Sustentam a Afirmação

As métricas de desempenho foram testadas em vários benchmarks de alto nível, incluindo:

- LongVideoBench: 62,5% com o modelo de 7B

- MLVU (Multimodal Long Video Understanding): 71,5% com o mesmo modelo

Notavelmente, até mesmo os modelos de 1B e 3B parâmetros forneceram resultados competitivos, provando que o tamanho nem sempre é o diferenciador. Essa é uma característica particularmente atraente para empresas que exploram a implantação móvel ou baseada em edge.

Além disso, graças à sua estratégia de treinamento conjunto, o modelo não sacrificou as capacidades de raciocínio de imagem. Ele compete em pé de igualdade com modelos de linguagem de imagem dedicados — uma clara vitória para o processamento multimodal unificado.

Eficiência Sem Compromisso

Em números brutos, os ganhos de eficiência são claros:

- Processa até 2× o número de frames

- Usa ~35% menos tokens do que modelos comparáveis

- Reduz significativamente os custos de computação, mantendo ou excedendo os níveis de desempenho

Este equilíbrio de precisão e eficiência desbloqueia uma gama mais ampla de casos de uso — desde câmeras inteligentes e sistemas de monitoramento IoT até assistentes de vídeo no aplicativo ou ferramentas de mineração de conhecimento empresarial.

Para os investidores, isso significa um ROI mais forte e menores barreiras à produção.

Valor Estratégico em Vários Setores

Integração de IA Empresarial: Com seu tamanho compacto e arquitetura eficiente, o SlowFast-LLaVA-1.5 pode ser implementado em ambientes onde largura de banda, poder de processamento e latência são restrições críticas — pense em vigilância no local, análise de comportamento do cliente no varejo ou diagnósticos de máquinas em campo.

Plataformas de Mídia e Streaming: A sumarização automatizada, a indexação de pesquisa e a moderação de conteúdo para mídia de longa duração tornam-se viáveis a um custo menor.

Tecnologia Assistiva e Acessibilidade: A interpretação em tempo real de vídeo para usuários com deficiência visual torna-se mais viável quando o processamento não exige infraestrutura em escala de nuvem.

Segurança e Defesa: Drones e sistemas de vigilância no dispositivo se beneficiam imensamente de modelos menores que podem analisar feeds ao vivo sem fazer o upload de gigabytes de vídeo.

Limitações e Oportunidades Abertas

Os autores reconhecem duas limitações principais:

- Limitações de Amostragem de Frames: Embora a amostragem de frames seja baseada em FPS para a maioria dos casos de uso, o modelo retorna à amostragem uniforme quando o comprimento do vídeo excede um limite de frames definido — potencialmente perdendo momentos críticos em conteúdo ultralongo.

- Codificador de Visão Congelado: Para preservar a eficiência, o codificador de visão permanece congelado durante o treinamento. Embora eficaz, o ajuste fino deste módulo pode desbloquear um desempenho maior, embora a um custo computacional maior.

Essas restrições apontam para as próximas etapas lógicas para versões futuras: técnicas de amostragem adaptáveis, ajuste seletivo do módulo de visão e integração de arquiteturas com eficiência de memória.

Por Que Isso Importa Para a Indústria

O paradigma de visão para linguagem está evoluindo rapidamente. Até agora, a maioria dos avanços na IA de vídeo se baseou na força bruta — modelos maiores, conjuntos de dados maiores, mais tokens.

O SlowFast-LLaVA-1.5 oferece uma abordagem estrategicamente mais enxuta. Não é apenas um novo modelo — é um modelo de como a IA eficiente pode escalar o entendimento de vídeo em todos os setores sem sobrecarregar a infraestrutura.

Ele demonstra que a eficiência de tokens pode ser tão poderosa quanto a escala de parâmetros — uma mensagem que tanto a comunidade de pesquisa quanto o ecossistema comercial precisam levar a sério.

Consideração Final Para Investidores e Construtores

Se o seu roteiro envolve o processamento inteligente de vídeo — seja para tecnologia de consumo, aplicações industriais ou análises em tempo real — o SlowFast-LLaVA-1.5 é um sinal de que IA de alto desempenho não precisa significar IA de alto custo.

Para o capital de risco, isso abre as portas para apoiar startups que antes não tinham recursos para treinar ou executar modelos de vídeo massivos. Para os construtores empresariais, é uma chance de implementar IA de vídeo competitiva sem reconstruir toda a sua pilha de infraestrutura.